A piros csapatos tesztelés (red teaming) nem egy új tesztelési technika, de az elmúlt időszakban szélesebb körben is egyre inkább figyelmet kap a mesterséges intelligencia (MI) rendszerek sérülékenységeinek tesztelésével kapcsolatban. Olyannyira így van ez, hogy az Egyesült Államok elnökének 2023. október 30-án kiadott MI rendelete kifejezetten előírja bizonyos MI rendszerek esetében a piros csapatos tesztelést.

Az alábbiakban röviden a piros csapatos tesztelés kérdésével foglalkozom, különös tekintettel az MI rendszereket érintően végzett ilyen jellegű tesztekre.

1. Mi az a piros csapatos tesztelés és miben tér el más tesztelési megoldásoktól?

A piros csapatos tesztelés lényege, hogy a sérülékenységeket, hibákat ellenséges módszerek, technikák alkalmazásával keresik, behozva ezzel a külső, a támadó általi nézőpontot a tesztelésbe. Az ilyen jellegű tesztelések során külső támadók kifinomult módszereit szimulálják annak vizsgálatára, hogy megállapítsák, a támadott szervezet, illetve annak folyamatai és az általa alkalmazott technológiai megoldások mennyire képesek ellenállni egy meghatározott céllal történő támadásnak. A tesztelés történhet manuálisan, de elképzelhető az is, hogy például MI rendszereket "engednek egymásra". (Utóbbi technikát mutatja be ez a 2022-ben megjelent tanulmány: Perez et. al: "Red Teaming Language Models with Language Models", amely nyelvi modellnek (LM) egy másik nyelvi modell alkalmazásával történő tesztelését vizsgálta.)

A piros csapatos tesztelés nem új megközelítés az IT biztonság, illetve a kiberbiztonság területén, már alkalmazzák egy ideje (a gyökerei egyébként a hadászatra nyúlnak vissza, az 1960-as évekig), de az MI rendszerek, különösen a nagy kockázatú rendszerek tesztelése esetén is fontos eleme lehet a kockázatok csökkentésére szolgáló eszköztárnak. A piros csapat mellett megjelenhet a kék csapat (blue team), amely a támadással szembeni védekező fél szerepét töltheti be. (Újabban pedig megjelent az ún. lila csapatos (purple team) tesztelés is, amely ötvözi a piros és kék csapatok feladatait és megközelítését.)

A piros csapatos tesztelés több szempontból is különbözik más tesztelési megoldásoktól, így különösen a penetrációs tesztektől (penetration testing). A penetrációs tesztek célja is a sérülékenységek keresése, de ezek tipikusan egy rendszerre fókuszálnak, rövidebb ideig tartanak, kevésbé változatos eszköztárral dolgoznak és - talán a legjelentősebb különbségként - nem feltétlenül emelik be a külső támadó szemléletmódját és teljes eszköztárát a megközelítésükbe. (Lásd a részletesebb összehasonlítást például itt vagy itt.)

2. Piros csapatos tesztelés és MI

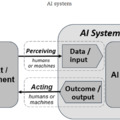

Az USA elnökének MI-re vonatkozó rendelete szerint, az "MI piros csapatos tesztelése" (AI red-teaming) olyan strukturált tesztelési erőfeszítéseket jelent, amelyek célja az MI rendszer hibáinak és sebezhetőségeinek megtalálása, gyakran kontrollált környezetben és az MI fejlesztőivel együttműködve. A tesztelést általában dedikált "piros csapatok" (red teams) végzik, amelyek a hibák és sérülékenységek (pl. az MI rendszer által adott veszélyes vagy diszkriminatív kimenetek, előre nem látható vagy nem kívánatos rendszerműködés, a rendszer korlátai, vagy a rendszer visszaélésszerű használatával összefüggő potenciális kockázatok) megtalálása érdekében ellenséges technikákat alkalmaznak. (Az USA elnökének MI-re vonatkozó rendelete kapcsán részletesebben - magyar nyelven - lásd Domokos Márton és Bálint János két részes cikkét a Jogi Fórumon: 1. rész, 2. rész.)

Az elnöki rendelet nem minden, csak meghatározott kritériumoknak megfelelő MI rendszerek esetében várja el a piros csapatos tesztek végzését. Ezen rendszerek tipikusan nagyon nagy számításai teljesítményt használnak. Az elnöki rendelet alapján a NIST (Nemzeti Szabványügyi és Technológiai Intézet) feladata lesz majd az MI rendszerek (elsősorban generatív MI, illetve kettős felhasználású alapmodellek) piros csapatos tesztelésére vonatkozó további szabályok, sztenderdek kidolgozása. (A NIST elnöki rendelettel összefüggő feladatairól és az elmúlt hónapokban történt fejleményekről lásd a NIST decemberi összefoglalóját.)

Az elnöki rendelet kiadását megelőzően a Fehér Ház lebonyolított egy eseményt, amelyen a nagy nyelvi modellek (LLM) sérülékenységeinek vizsgálatára irányuló piros csapatos tesztelésre került sor annak érdekében, hogy ezen modellek használatával felmerülő kockázatokról jobb képet nyerjenek. Az esemény kapcsán megállapításra került, hogy a piros csapatos teszelés hasznos eszköz lehet az MI-vel összefüggő új kockázatok feltárásában (nem csak a biztonságot érintően, hanem pl. a diszkrimináció vagy a magánszféra sérelmének veszélyeire vonatkozóan) és így nem véletlen, hogy ez a tesztelési forma végül az elnöki rendeletben is megjelent.

A generatív MI rendszerek és az egyéb MI rendszerek piros csapatos tesztelése között jelentős megközelítésbeli különbség lehet, tekintettel arra, hogy a generatív MI megoldások működése eltérő az egyéb MI rendszerekétől és ennek a tesztelés kapcsán is vissza kell köszönnie. Ennek megfelelően a generatív MI rendszerek piros csapatos tesztelése leginkább a "rosszindulatú" prompt, illetve input generálás útján történhet. (Lásd részletesebben a generatív MI modelleket érintő piros csapatos tesztelés tapasztalatairól a Harvard Business Review-ban a napokban megjelent cikket: Andrew Burt: "How to Red Team a Gen AI Model", továbbá a piros csapatos tesztelés gyakorlati alkalmazására jó példa az alábbi tanulmány: "Red Teaming Language Models to Reduce Harms: Methods, Scaling Behaviors, and Lessons Learned".)

A hírek szerint a tavaly decemberi politikai kompromisszum alapján az EU MI rendeletében is megjelenhet a piros csapatos tesztelés követelménye az általános célú MI rendszerek (general purpose AI) tekintetében.